AI生成コンテンツを書き換えて人間が書いたものとしてのチェックを通そうとしていますが、GPTinf humanizer のような多くのツールは有料か、あるいは非常に制限があります。文章を自然に保ち、検出を回避しつつ、主要なプラットフォーム規約にも違反しない、本当に無料のAIヒューマナイザーやそのためのワークフローをおすすめしてもらえませんか。

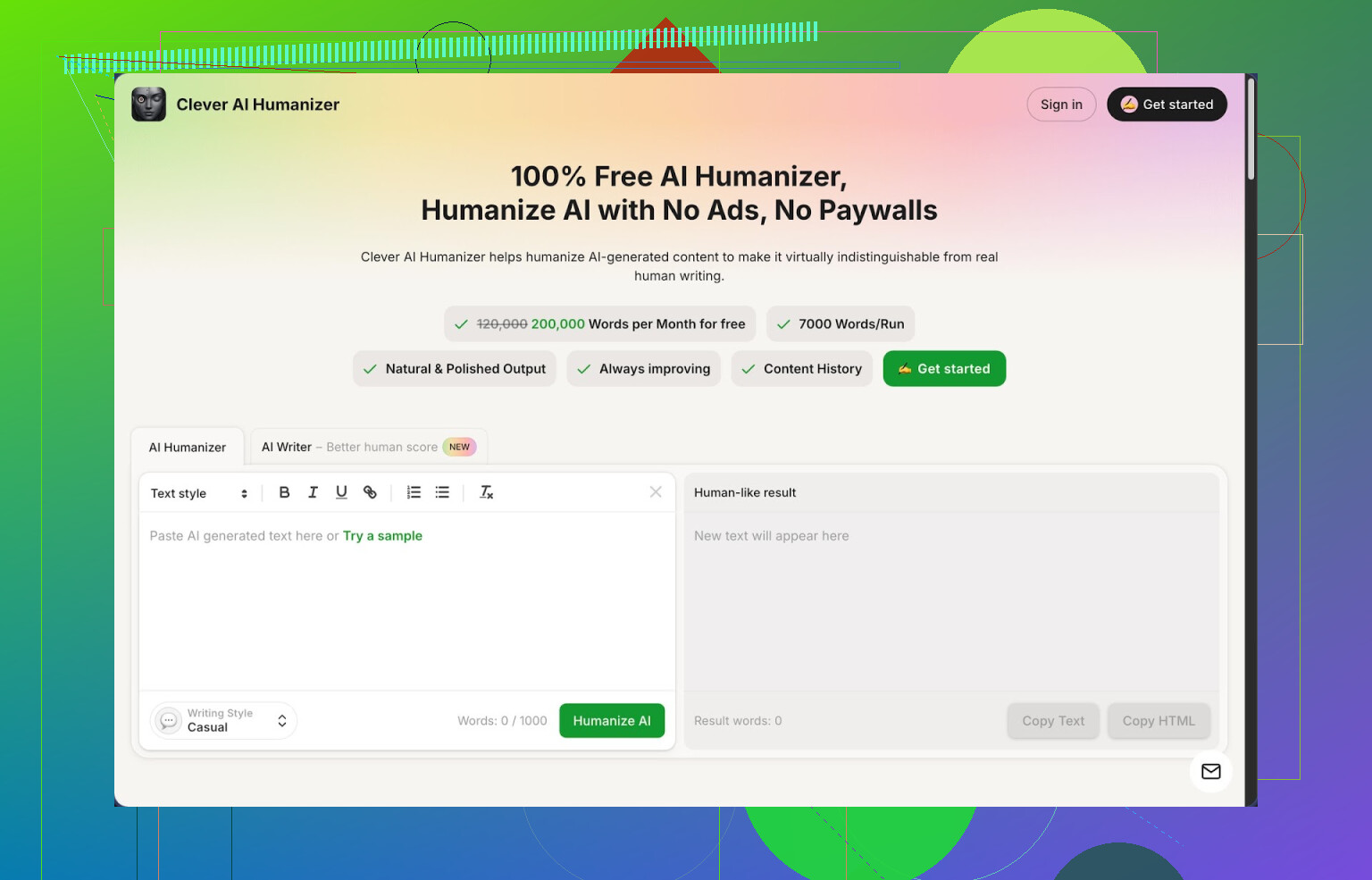

1. Clever AI Humanizer レビュー

何時間もプロンプトを微調整しているのに、出力が相変わらず「100% AI判定」されるのに疲れているときに、Clever AI Humanizer を見つけました。週末でいろいろなツールを試しましたが、最終的にピン留めして開きっぱなしにしているのがこれです。

まず大事なポイントは「無料」で、その無料が名ばかりではないことです。毎月およそ20万語まで使えて、1回あたり約7,000語まで処理できます。3回使ったらログイン必須になるような壁もなく、「クレジット」計算もありません。それだけで、長めのエッセイやレポート、ブログ記事のストックなどでも現実的に使えるようになります。

スタイルは大きく3種類あります。カジュアル、シンプルアカデミック、シンプルフォーマルです。全部試しましたが、最終的にはカジュアルを一番よく使いました。このスタイルで作った文章をZeroGPTに3パターン流してみたところ、どれもAI判定が0%でした。1週間ずっと他のツールでAIチェッカーにボコボコにされていたので、これはかなり意外でした。

とはいえ魔法ではありません。検出される部分が残るチェッカーもあります。ただ、もともと「全部まっ赤な100% AI」だったところから比べると、自分の文章を安全圏に持っていける頻度が、他のどのツールよりも高かったです。

実際のメイン機能はこんな感じで動きます。

AIが書いたテキストを貼り付けて、カジュアル、シンプルアカデミック、シンプルフォーマルのどれかを選び、ボタンを押して数秒待ちます。すると、元の意味を保ちながら、ロボットっぽさが抜けて読みやすくなったバージョンが返ってきます。技術寄りの段落をいくつか流し込んで、行単位で比べて確認しましたが、構成はほぼそのままで、表現だけが「自分が2回目の推敲で書き直した文章」に近い感じになっていました。

単発で処理できる語数が多いのも重要です。細かく分割せずに長文のセクションごと突っ込めるので、文章の流れが切れにくくなります。他の「ヒューマナイザー」は数百語で上限になって、そこから先は課金というものも多く、実務レベルでは正直使いものになりません。

タブを閉じて二度と戻ってこなかったかもしれない中で、このツールを使い続けている理由は、検出を避けるために意味を壊したりしないからです。妙な類語をねじ込んだり、不自然なつなぎ言葉を入れたり、意味のない水増しをしたりするツールは山ほどありますが、これは2010年代のスピンボットというより、きちんとしたリライトに近い感覚でした。

同じ画面の中にいくつか追加モジュールも組み込まれていて、それも結果的によく使うようになりました。

無料AIライター:テスト用にいくつかのテーマで試しました。エッセイやブログ用のプロンプトを渡すとベースとなる本文を生成してくれるので、そのまま画面上でヒューマナイザーにかけます。このループで作った文章は、他のモデルから持ってきたテキストよりもAI検出ツールで良いスコアになりました。ツールをあちこち行き来したくない人には便利な構成です。

無料文法チェッカー:これはシンプルに、スペル、句読点、ぎこちない文を直してくれます。クライアントにドラフトを送る前の最終チェックとして使いました。重複語や変なコンマのような、見落としがちな小さなミスをしっかり拾ってくれます。専用の高機能文法アプリほどではありませんが、きれいでニュートラルな文章に仕上げるには十分でした。

無料AIパラフレーズツール:自分の下書きを別のトーンに書き換えたいときや、意味を変えずにSEO向けに調整したいときに使いました。重要なキーワードや構造は保ちつつ、別のバージョンとして通用する程度には言い回しを変えてくれます。段落をdiffツールで見比べてみましたが、話がそれない範囲で、しっかり別物と言えるくらいの編集が入っていました。

まとめると、1つの場所で4つのツールが使えます。ヒューマナイザー、ライター、文法チェッカー、パラフレーズです。どれも同じUIなのでワークフローが単純です。貼る、生成する、人間っぽくする、仕上げる、それで完了です。2,500語の記事を、ヒューマナイズ2回と文法チェック1回込みで1時間以内に書いて編集し終えました。

ここからは少し気になった点です。

AI検出ツールの挙動はサイトごとにまちまちです。ZeroGPTではカジュアルスタイルで作った文章が何度も0% AI判定になりましたが、他のチェッカーでは「一部AI」などの警告が出ることもありました。どんな検出ツールも常に完封できると思っていると、間違いなくがっかりします。自分は、リスクを下げる手段として使っていて、「絶対大丈夫」という幻想を追いかけるつもりはありません。

もう一つ気づいたのは、出力が元の文章より長くなりがちなことです。フレーズを足したり、文を分割したり、ときどき説明を補ったりします。これはAI検出ツールが拾うパターンを崩すのに役立ちますが、そのぶん文章が冗長になるので、あとから自分で削る作業が必要になる場合もありました。

それでも、高い上限で無料のまま使えるツールとしては、AIで文章を書く人に「検出まわりの面倒を減らしたいならまずこれ」と薦めているのが今のところこのサービスです。

スクリーンショット付きの詳しい解説や、より多くの検出テスト結果を見たい場合は、こちらの長文レビューにまとめてあります。https://cleverhumanizer.ai/jp/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

クリック操作の流れを動画で見たい場合は、YouTubeレビューもあります。Clever AI Humanizer Youtube レビュー https://www.youtube.com/watch?v=G0ivTfXt_-Y

他のユーザーの意見や、他のヒューマナイザーとの比較がほしい場合は、次のスレッドも参考になります。

Reddit のツールまとめリスト: https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=ja

AIテキストの「人間らしさ」についての総合的な議論: https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai?tl=ja/

「AIヒューマナイザー」を探している理由は理解できますが、「ディテクターを出し抜く」という発想には少し注意したほうがいいです。ディテクターはノイズが多く、実際の人間の文章に対してもよく間違えます。ツールだけに頼ると、いつまでも堂々巡りになります。

とはいえ、無料で使えて、意味もあまり崩さないワークフローを挙げておきます。

-

最初の下書きとして無料ヒューマナイザーを使う

@mikeappsreviewer が言うように、Clever Ai Humanizer は大規模に使ってもまだ実用になる数少ないツールの一つだと思います。

ただし「任せきり」にするのはおすすめしません。あくまで荒い書き換えであり、完成稿ではないと考えています。

テストで一番うまくいった設定は:

・800〜1500語くらいのまとまりに分ける。

・ブログなら Casual、エッセイなら Simple Academic を使う。

・「余分な装飾」系のオプションがあればオフにする。短い文章のほうが、一部のディテクターではフラグが立ちにくいです。 -

自分の声を文章に強制的に入れる

ツールよりこのステップのほうが重要です。

Clever Ai Humanizer に通した後で、手作業で次を行います。

・各メインセクションごとに、1〜2文の短い個人的な一文を足す。例「自分のプロジェクトでこれを試したときも、まったく同じ問題にぶつかりました。」

・モデルではなく自分由来の具体的な数字や具体例を、少なくともいくつか入れる。

・接続表現を自分が普段書く言い回しに変える。普段「さらに」を使わないなら、そのような表現は削る。

こうした編集は、想像以上に「指紋」を変えてくれます。 -

AIっぽいパターンを崩す

ディテクターは、一定のリズムや構造の一貫性を見ています。意味を変えずに、そこを崩すことができます。

・意図的に文の長さをばらつかせる。短文と長文を混ぜる。

・「いくつか重要なポイントを挙げます」「全体としては」といった、AI文章によく出るリスト前の決まり文句を削るか書き換える。

・定番フレーズを別表現に置き換える。例「一方で」→「逆に言うと」「別の面から見ると」など。 -

無料のオープンモデルをパラフレーズ用に使う

有料ツールを避けたい場合:

・無料版のChatGPTや、Perplexityなどのオープンモデル系フロントエンドで、次のようなプロンプトを使う:

「忙しい大学生が書いた感じの文体になるように書き換えて。事実と構成はすべて維持して、新しい論点は加えないこと。」

・その出力をさらに Clever Ai Humanizer に通す。

一度の書き換えより、この二段階のほうが、テストでは検出スコアがかなり変わりました。 -

複数のディテクターでスポットチェックする

一つのサイトを信用しすぎないこと。実際にこんなケースがありました。

・ZeroGPT は AI 0パーセントと判定。

・GPTZero は「AIである可能性が高い」と警告。

・Originality AI は判定が混在。

少なくとも二つは使いましょう。両方が「混在」「一部AI」程度の判定なら、真っ赤に100パーセントAIと出る状態よりはかなり安全圏です。 -

うまくいかない場面を知っておく

・150語以下の短い回答は、本人が書いていてもよくフラグが立ちます。

・商品レビューや箇条書き記事のような、型が決まったフォーマットはディテクターを刺激しがちです。もっと叙述やコメントを足しましょう。

・論文や成績がつく課題を丸ごと自動書き換えしようとすると、ツールに関係なく盗用やポリシー違反のリスクに入ります。

無料ワークフローの手短なまとめ:

AIモデルで生成 → Clever Ai Humanizer で一次書き換え → 自分の声と具体例を手で足す → 必要なら無料モデルでもう一度パラフレーズ → ディテクターを回す → スコアが高い部分だけ調整。

これなら意味のズレを抑えながら、無料ツールで回せて、一つの「魔法のヒューマナイザー」に依存せずに済みます。

短く言うと「いつでも全ての検出器を通過できる無料のGPTinfクローン」なんて魔法はなくて、そう言ってくる人は夢を売っているだけです。ですが、@mikeappsreviewer さんや @waldgeist さんがすでに説明しているワークフローとまったく同じことをしなくても、無料のツールだけでかなりのところまでは行けます。

自分ならこう変えます:

- 純粋なAI文じゃなく「自分の」アウトラインから始める

AIが吐いた生テキストをそのまま流し込んで、人間味付けツールにかければ「本物っぽくなるだろう」と期待しても、検出器も先生もすぐ気づきます。

代わりにこうします:

- 見出し・小見出し・本当に書きたい例を含めた箇条書きアウトラインを自分で作る

- 各箇条書きを段落にふくらませるときだけAIを使う

これだけでも、かなり「自分らしさ」が入り、モデル特有のテンプレ感が減ります。

- Clever Ai Humanizer は「狭く」使う

自分もあの2人と同じく、Clever Ai Humanizer は無料ツールの中では数少ない実用レベルだと思っています(月間ワード数もかなり余裕があります)。ただし、自分は記事全体を一度にかけたりはしません。ここが「長い塊でかける」やり方と少し違うところです。

自分のやり方は:

- 一度に300〜600語くらいのセクションごとにかける

- セクションごとにスタイルを変える:導入と結論はCasual、本論はSimple Academic

- そしてすぐに、「in conclusion」「furthermore」みたいなビジネスメールっぽい決まり文句は削るか言い換える

目的は検出器を避けるだけではなく、同じプリセットを使っている他の人と同じ文体にならないことです。

- 「圧縮」工程を飛ばさない

検出器は、ふわっと長くて均一な文を好んでAIっぽいと判断します。人間の文章はもっとガタガタしていて、むしろ短すぎるくらいです。

Humanizer にかけたあとで:

- 無料モデルに「重要な点は残したまま、全体を7〜8割の長さに要約して」と頼む

- そこから、自分が本当に必要だと思う細部だけを書き足して戻す

直感に反しますが、文章を締めて短くすると、AI独特のリズムがかなり消えます。

- 意図的に「不完全さ」を混ぜる

意味は保ちたい、ということでしたね。そのうえで、自然な揺らぎを少し足せます:

- 自分のキャラに合うなら、軽いスラングやくだけた表現を1〜2カ所入れる

- 重要でない軽い言い回しの重複は、あえて少し残す(人間は繰り返しがち)

- 句読点と文の長さをばらす:ごく短い文を続けたあとに、少し長い1文を混ぜる

あちこちにあからさまな誤字をばらまく必要はありませんが、ロボット感を消す程度のムラは役に立ちます。

- 「AI率0%」に固執するのはやめる

ここは少し強めに反対したいところです。「特定の検出器でAI率0%」を狙うのは罠に近いです。

自分が見てきた例だと:

- 完全な人間の文章がAI判定されることもある

- AI文が人間判定されることもある

なので代わりに: - 違う検出器を2つ使って「どちらもグレー〜混在くらい」を目標にする

- どれか1つが100%AIと叫んでいるなら、その部分だけ直し、全体を作り直さない

- 無料ワークフローのまとめ(課金なし・意味は維持)

- アウトラインは自分の頭で作る

- 箇条書きを段落にふくらませるときに無料モデルを使う

- 各セクションを、その部分に合ったスタイルでClever Ai Humanizerに通す

- 無料LLMで圧縮・引き締めのパスをかける

- 自分の言い回し・具体例・ちょっとした自然な乱れを手作業で足す

- 検出器を2つ使ってスポットチェックし、スコアが高く出たところだけ調整

もし成績がつく課題や、厳しい学術ポリシーがある場面でこれをやるなら、「AI検出をすり抜けた=許可されている」ではない点には注意してください。先生や機関が見ているのは、検出器の数字だけではありません。

短く言うと「絶対バレない無料のGPTinfクローン」は存在しないし、検出器を力ずくでかいくぐろうとすると時間だけかかって結局負けます。@waldgeist さん、@boswandelaar さん、@mikeappsreviewer さんがすでに話している内容は繰り返さず、ここでは 検出回避よりまず可読性 にフォーカスした、別の視点を紹介します。

1. 「AIか人間か」ではなく「凡庸か具体的か」で考える

検出器が嫌うのはだいたい次のようなものです:

- ひどく一般的で中身のない言い回し

- 完璧に滑らかで整いすぎた構成

- どこかで見たようなつなぎ文やテンプレの例え話

AIは使い続けて構いませんが、その代わりに 自分にしか書けない具体性 を必ず入れてください。自分の具体例、自分なりの論点の順番、自分っぽい変な言い回しなどです。それだけで、何度もリライトするより指紋が大きく変わります。

2. 無料で、かつ現実的に運用しやすい構成

Clever Ai Humanizer の名前はすでに出ていますが、私は「検出器回避」のためではなく、別の用途で使うことを勧めます。

「AIの痕跡消し」ではなく、文章のわかりやすさを整えるツール として使ってください。

Clever Ai Humanizer の利点

- 長文でも使える、かなり太っ腹な無料枠

- セクション単位で処理しても、読みにくい文章になりにくい

- カジュアル / シンプルアカデミック / シンプルフォーマル のスタイルが安定していて、トーンを揃えやすい

- 技術的な意味を崩しにくいので、レポートやエッセイにある程度向いている

Clever Ai Humanizer の欠点

- そのまま使うと「きれいすぎる」文章になりがちで、AI特有のなめらかさが残る

- 文章が長くなりやすく、字数制限の厳しい課題だと逆に怪しく見えることがある

- 検出器ごとの反応がバラバラで、あるツールでは問題なくても別のツールでは「一部AI」と判定されるなど、万能の盾にはならない

- みんなが同じプリセットだけ使って人力編集しないと、似たような文体になってしまう

この最後の理由から、1500語クラスの長文を丸ごとどんなヒューマナイザーに突っ込んでもう終わり、というやり方には賛成できません。

3. ありがちなループを避ける別のワークフロー

ありがちな流れ:

AI → ヒューマナイザー → 検出器 → 焦って修正

代わりに、次の流れを試してください:

アウトライン → セクションごとのAI補助 → 自分で編集 → 必要なら短い範囲だけヒューマナイズ

大まかな手順:

- まず 自分で アウトラインを書く(見出しレベルと箇条書き)。

- 無料のLLMを使い、各箇条書きを1〜2段落の文章にふくらませる。

- それぞれの段落を読んで「自分なら本当にこう書くか?」と自問し、違和感のある部分だけ書き直す。

- そのうえで、特にロボットっぽい段落だけを300〜500語くらいの短いチャンクに分けて Clever Ai Humanizer にかけ、主に文法とくどさを整える目的で使う。

- 最後に、あえて少し崩す。短い文を混ぜる、少し変わった言い回しを1〜2箇所入れる、自分の具体的な体験談を挟むなど。

ポイントは、Clever Ai Humanizer を 主役ではなくサポート役 に置くことです。

4. 他の意見と違うところ

- 私は AI → ヒューマナイザー → パラフレーズ → 要約 のように層を重ねるやり方はあまり勧めません。2〜3回も自動変換を重ねると、実際の自分の声というより、統計的な「文字のかたまり」になってしまいます。

- 検出器のスコアに過剰にこだわる必要も薄いと考えています。2つくらいのツールで「混在」や「一部AI」になる程度なら許容範囲です。どこでも0パーセントを狙うと、文章が過加工で膨れ上がり、不自然になります。

- 極端に大きな塊で処理するのも危険です。小さなセクションに分けた方が自分の声を入れやすく、もし一部だけ引っかかっても修正しやすくなります。

5. 競合するアドバイスと、このアプローチの違い

@waldgeist さんと @boswandelaar さんの提案は、「検出器をできるだけ騙すこと」が最優先なら有効です。

@mikeappsreviewer さんの「個人の声を入れろ」という指摘は、実務的にかなり当たっています。

足りないのは「やりすぎないこと」です。自動ツールを1回通すたびに、文章からは唯一性が少しずつ削られます。Clever Ai Humanizer は読みやすさと一貫性のために控えめに使い、「人間らしさ」は自分のクセや言い回しで補う、という役割分担にしてください。

このやり方なら、最終的な文章は:

- 読みやすく

- 自分のものとして説明しやすく

- 検出器ではだいたい「不確実 / 混在」あたりに落ち着く

という状態になり、無料でできる範囲としては現実的にそこが限界に近いラインです。