Ik probeer door AI gegenereerde content te herschrijven zodat deze door controles voor menselijk geschreven tekst komt, maar de meeste tools zoals GPTinf humanizer zijn betaald of erg beperkt. Kan iemand een echt gratis AI-humanizer of workflow aanraden die de tekst natuurlijk houdt, detectie vermijdt en geen belangrijke platformregels schendt?

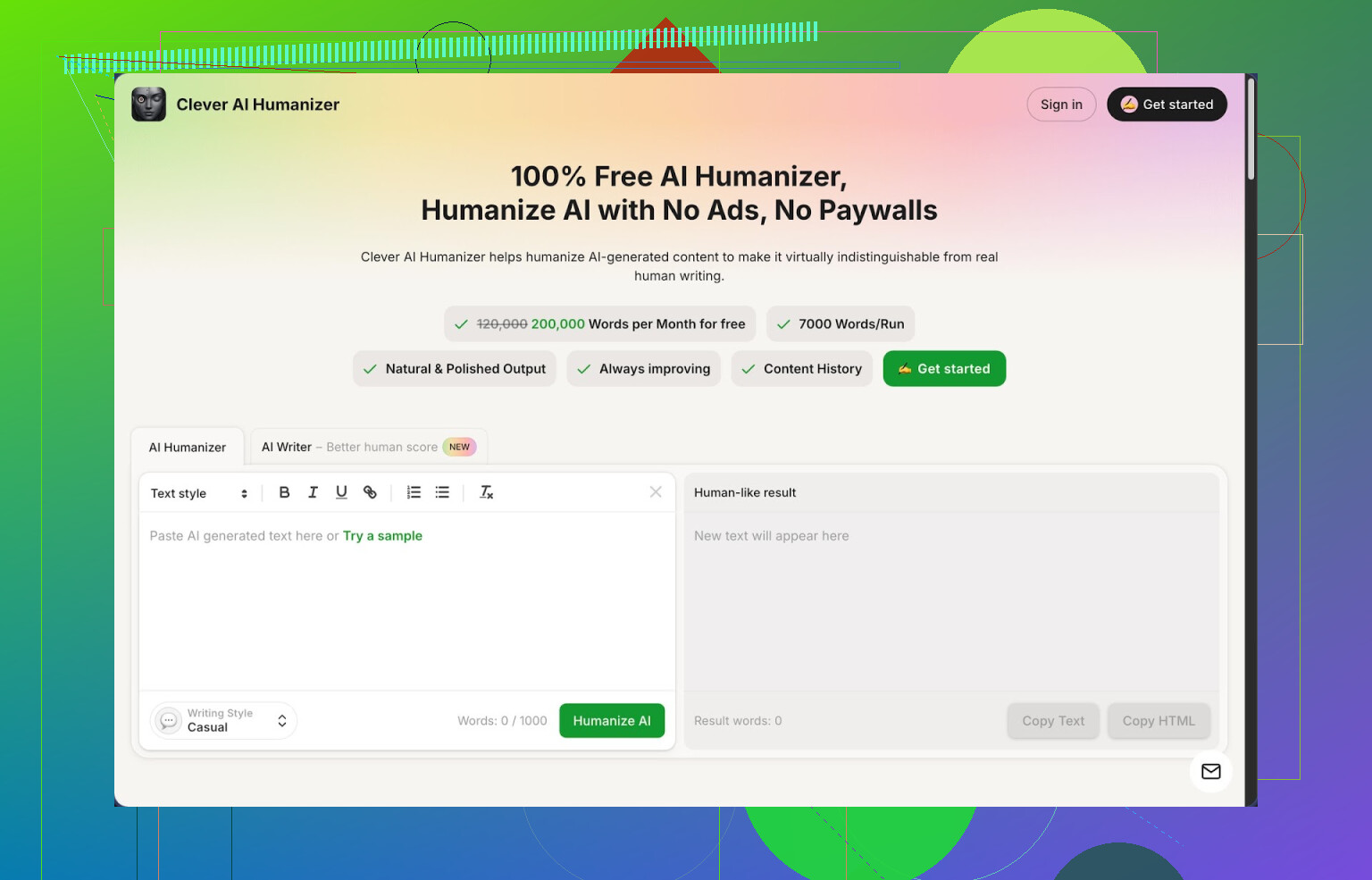

1. Clever AI Humanizer review

Ik kwam Clever AI Humanizer tegen nadat ik het zat was om urenlang prompts te tweaken en mijn teksten nog steeds als 100% AI werden aangemerkt. Ik ben in één weekend door een hele reeks tools gegaan, en dit is degene die ik als vastgepinde tab open liet staan.

Het belangrijkste punt: het is gratis en de limieten zijn niet schijn-gratis. Je krijgt ongeveer 200.000 woorden per maand, en het verwerkt tot grofweg 7.000 woorden in één keer. Geen login-paywalls na drie pogingen, geen “credits”-rekensom. Dat alleen al maakt het bruikbaar voor lange essays, rapporten of een hele lijst blogposts.

Het heeft drie hoofdstijlen: Casual, Eenvoudig Academisch en Eenvoudig Formeel. Ik heb ze alle drie getest, maar uiteindelijk gebruikte ik Casual het meest. Met die stijl heb ik drie verschillende voorbeelden door ZeroGPT gehaald, en elk kwam terug als 0% AI. Dat verbaasde me, want ik werd de hele week door AI-detectors afgekraakt met andere tools.

Het is natuurlijk geen magie. Sommige detectors pikken nog steeds delen eruit. Maar als je uitgangspunt is dat “alles vuurrood 100% AI” is, dan bracht dit mijn teksten vaker in de veilige zone dan welke andere tool dan ook die ik heb geprobeerd.

Zo werkt het belangrijkste onderdeel in de praktijk.

Je plakt AI-tekst erin, kiest Casual, Eenvoudig Academisch of Eenvoudig Formeel, drukt op de knop en wacht een paar seconden. Het geeft een versie terug die minder robotachtig klinkt en vloeiender leest, terwijl het toch dicht bij je oorspronkelijke idee blijft. Ik heb dit gecontroleerd door meerdere technische alinea’s erdoor te halen en regel voor regel te vergelijken. De structuur bleef grotendeels intact, maar de zinsbouw leek meer op iets dat ik zelf zou schrijven na een tweede redactieronde.

De hogere woordlimiet is belangrijk. Ik gooide volledige secties van longform content erin in plaats van alles in kleine stukjes te breken, wat de samenhang beter bewaart. Sommige andere “humanizers” stoppen bij een paar honderd woorden en gaan daarna rekenen, wat ze nutteloos maakt voor serieus werk.

Wat voorkwam dat ik de tab sloot en nooit meer terugkwam, is dat het je betekenis niet sloopt om detectors te omzeilen. Genoeg tools gooien er rare synoniemen in, onnatuurlijke overgangen en willekeurige opvulling. Deze voelde meer als een zorgvuldige herschrijving dan als een spinbot uit 2010.

Er zitten een paar extra modules in dezelfde interface ingebakken, en die ben ik ook gaan gebruiken.

Gratis AI-schrijver: Ik heb dit op een paar testonderwerpen geprobeerd. Je geeft een prompt voor een essay of blogpost, hij genereert de basisinhoud, en daarna haal je die direct door de humanizer. Die cyclus gaf me betere scores bij AI-detectors dan wanneer ik content uit andere modellen haalde. Als je niet tussen tools heen en weer wilt springen, is deze opzet handig.

Gratis grammaticacontrole: Deze is rechttoe rechtaan. Hij corrigeert spelling, interpunctie en onhandige zinnen. Ik gebruikte hem als laatste controle voordat ik een concept naar een klant stuurde. Hij pakte de kleine dingen die de meeste mensen laten zitten, zoals dubbele woorden of haperende komma’s. Het is niet zo geavanceerd als sommige speciale grammar-apps, maar het was genoeg voor nette, neutrale tekst.

Gratis AI-parafrasetool: Ik gebruikte die wanneer ik mijn eigen concepten in een andere toon wilde herschrijven of iets voor SEO moest aanpassen zonder de betekenis te veranderen. Het behield kernbegrippen en structuur, terwijl de bewoording genoeg verschoof om als aparte versie door te gaan. Ik heb alinea’s naast elkaar in een diff-tool vergeleken, en de aanpassingen waren aanzienlijk zonder van het onderwerp af te dwalen.

Alles bij elkaar krijg je vier tools op één plek: humanizer, schrijver, grammaticacontrole en parafrasetool. Ze delen allemaal dezelfde interface, dus je workflow blijft simpel. Plakken, genereren, humanizen, opschonen, klaar. Ik heb er een volledig artikel van 2.500 woorden mee geschreven en bewerkt in minder dan een uur, inclusief twee humanization-rondes en één grammar-check.

Dan nu de irritante kanten.

Detectors gedragen zich niet overal op internet hetzelfde. Op ZeroGPT kreeg ik meerdere keren 0% AI met de Casual-stijl. Bij andere detectors zag ik nog steeds meldingen als “gedeeltelijk AI” of iets dergelijks. Als je verwacht dat een tool elke detector altijd verslaat, kom je bedrogen uit. Ik gebruik het om risico te verlagen, niet om een neppe garantie na te jagen.

Nog iets wat me opviel: de output is vaak langer dan de oorspronkelijke input. De tool voegt zinsdelen toe, knipt zinnen op en geeft soms extra uitleg. Dat helpt om patronen te doorbreken waar detectors op aanslaan, maar betekent ook dat je conceptteksten wolliger worden. Ik heb sommige stukken achteraf nog handmatig moeten inkorten.

Zelfs met die minpunten is dit, voor een tool die gratis blijft met hoge limieten, degene die ik blijf aanraden aan mensen die met AI schrijven en minder gedoe met detectie willen zonder allerlei abonnementen te stapelen.

Als je een uitgebreidere analyse met screenshots en meer detectietests wilt, staat hier een langere review: https://cleverhumanizer.ai/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

Er is ook een YouTube-review als je liever iemand anders ziet doorklikken: Clever AI Humanizer YouTube-review https://www.youtube.com/watch?v=G0ivTfXt_-Y

Als je meer meningen uit de community of vergelijkingen met andere humanizers wilt, bekijk dan deze discussies:

Reddit-lijst met tools: https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=nl

Algemene discussie over het humanizen van AI-tekst: https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai?tl=nl/

Ik snap waarom je op zoek bent naar AI humanizers, maar ik zou een beetje oppassen met het hele idee om detectors te verslaan. Detectors zijn ruisgevoelig en vaak fout, zelfs bij echte menselijke tekst. Als je alleen op tools vertrouwt, blijf je in cirkels draaien.

Toch kun je zo werken dat het gratis blijft en de betekenis goed behouden blijft:

-

Gebruik een gratis humanizer als eerste stap

Ik ben het eens met @mikeappsreviewer dat Clever Ai Humanizer een van de weinige tools is die op schaal echt bruikbaar aanvoelt.

Ik ben alleen geen fan van instellen en vergeten. Ik zie het als een ruwe herschrijving, niet als definitieve versie.

Instellingen die in mijn tests het beste werkten:

• Werk in blokken van 800 tot 1500 woorden.

• Gebruik Casual voor blogstijl, Simple Academic voor essays.

• Zet alle extra-fluf opties uit als die er zijn. Kortere tekst triggert bij sommige detectors minder flags. -

Dwing je eigen stem in de tekst

Deze stap is belangrijker dan welke tool dan ook.

Na de Clever Ai Humanizer-run doe je dit handmatig:

• Voeg in elke hoofdsectie 1 of 2 korte persoonlijke zinnen toe. Voorbeeld: When I tried this on my own project, I hit the same issue.

• Voeg minstens een paar concrete cijfers of voorbeelden toe die echt van jou komen, niet van het model.

• Pas overgangen aan naar hoe jij normaal schrijft. Als jij nooit moreover zegt, haal het weg.

Deze aanpassingen veranderen de vingerafdruk meer dan mensen denken. -

Doorbreek AI‑patronen

Detectors letten op een consistente cadans en structuur. Die kun je verstoren zonder de betekenis te veranderen.

• Varieer bewust in zinslengte. Meng korte en lange zinnen.

• Haal inleidingen bij lijstjes weg of herschrijf ze, zoals Here are some key points of Overall, die vaak in AI‑output voorkomen.

• Vervang generieke zinnen. Voorbeeld: On the other hand → On the flip side of On the other side of this. -

Gebruik gratis open modellen als parafrase‑tool

Als je betaalde tools wilt vermijden:

• Gebruik de gratis ChatGPT‑laag of een open model via bijvoorbeeld Perplexity of andere frontends, met een prompt als:

Rewrite this so it matches the writing style of a busy college student. Keep all facts and structure. Do not add new points.

• Laat die output daarna door Clever Ai Humanizer gaan.

Deze tweestapsaanpak verlaagde in mijn tests de detectiescores veel sterker dan één enkele herschrijving. -

Check steekproefsgewijs met meerdere detectors

Vertrouw niet op één site. Ik zag gevallen waarin:

• ZeroGPT 0 percent AI aangaf.

• GPTZero het bestempelde als highly likely AI.

• Originality AI gemengde resultaten gaf.

Gebruik er minimaal twee. Als beide het bestempelen als mixed of partially AI, zit je al veiliger dan bij 100 percent rood. -

Weet waar dit misgaat

• Korte antwoorden onder de 150 woorden worden vaak geflagd, zelfs als je ze zelf schrijft.

• Sterk gestructureerde formats zoals productreviews of listicles triggeren detectors snel. Voeg meer verhalende uitleg of commentaar toe.

• Als je hele scripties of beoordeelde opdrachten automatisch probeert te herschrijven, loop je hoe dan ook tegen plagiaat- en beleidsproblemen aan, ongeacht de tool.

Korte gratis workflow‑samenvatting:

AI‑model om te genereren → Clever Ai Humanizer als eerste stap → handmatige edit voor eigen stem en voorbeelden → optionele tweede parafrase met een gratis model → detectors draaien → alleen de stukken bijwerken die hoog scoren.

Zo blijft de betekenis dicht bij het origineel, gebruik je alleen gratis tools en leun je niet op één magische humanizer.

Kort antwoord: er bestaat geen magische gratis GPTinf‑kloon die altijd elke detector passeert, en iedereen die dat anders voorstelt verkoopt je een droom. Maar je kunt wél behoorlijk ver komen met een gratis stack zonder exact dezelfde workflow te doen die @mikeappsreviewer en @waldgeist al hebben beschreven.

Dit is wat ik anders zou doen:

- Begin met jouw eigen outline, niet met pure AI‑tekst

Als je rauwe AI‑brij invoert en hoopt dat een humanizer het “authentiek” maakt, hebben zowel detectors als docenten dat zo door.

In plaats daarvan:

- Maak zelf een bullet‑outline (kopjes, subpunten, voorbeelden die jij echt belangrijk vindt).

- Gebruik AI alleen om elke bullet uit te werken tot een alinea.

Dat zorgt meteen voor meer “jij” en minder generiek modelpatroon.

- Gebruik Clever Ai Humanizer heel gericht

Ik ben het met hen eens dat Clever Ai Humanizer een van de weinige echt bruikbare gratis tools is (de maandelijkse woordlimiet is royaal), maar ik haal geen complete artikelen in één keer door die tool. Daarin verschil ik wat van mening met de aanpak met “lange blokken”.

Ik geef de voorkeur aan:

- Secties van 300–600 woorden per keer

- Per sectie de stijl wisselen: Casual voor intro/conclusie, Simple Academic voor de kern

- En daarna meteen alle formuleringen schrappen of aanpassen die klinken alsof ze in een corporate e‑mail thuishoren (al die “concluderend”, “bovendien”, enzovoort)

Je probeert niet alleen detectors te ontwijken, je probeert ook niet te klinken als iedereen die dezelfde preset gebruikt.

- Sla geen “compressie”‑ronde over

Detectors zijn dol op wollige, gelijkmatig geformuleerde tekst. Menselijke tekst is rommelig en vaak te kort.

Na het humanizen:

- Laat een gratis model samenvatten met zo’n “vat dit samen tot 70–80% van de lengte, behoud alle kernpunten”.

- Voeg daarna handmatig alleen de extra details terug die jij echt belangrijk vindt.

Tegenintuïtief, maar de tekst aanscherpen haalt veel van het AI‑ritme eruit.

- Voeg bewust “imperfecties” toe

Je zei dat je de betekenis wilt behouden. Dat kan, terwijl je kleine, realistische oneffenheden toevoegt:

- Gebruik 1–2 milde, informele uitdrukkingen als dat bij jouw stijl past.

- Laat een paar niet‑cruciale, lichte herhalingen staan. Mensen herhalen zich.

- Varieer de interpunctie: een paar korte, hakkelige zinnen en dan weer een langere samengestelde.

Je hoeft echt geen duidelijke typefouten overal in te strooien, maar een beetje niet‑robotische inconsistentie helpt.

- Stop met de obsessie over 0%‑scores

Ik ben het fundamenteel oneens met dat doel: jagen op “0% AI” op één detector is een valkuil.

Ik heb gezien dat:

- Menselijke tekst als AI werd aangemerkt

- AI‑tekst als menselijk werd aangemerkt

Dus richt je liever op: - Een “gemengd” of “onzeker” resultaat op 2 verschillende detectors.

- Als één tool 100% AI roept, fix dan alleen dat specifieke stuk, niet het hele document.

- Gratis workflow‑samenvatting (geen paywalls, betekenis blijft scherp)

- Jij maakt handmatig de outline.

- Gebruik een gratis model om bullets uit te werken tot alinea’s.

- Haal elke sectie door Clever Ai Humanizer met een stijl die past bij dat deel.

- Doe een compressie‑/aanscherpingsronde met een gratis LLM.

- Voeg handmatig je eigen formuleringen, voorbeelden en een beetje natuurlijke rommel toe.

- Check steekproefsgewijs met 2 detectors en pas alleen sterk geflagde stukken aan.

Als je dit doet voor beoordeeld werk of iets met strikte academische regels, onthoud dan dat “AI‑checks doorstaan” niet hetzelfde is als “toegestaan”. Detectors zijn niet het enige waar je docent of instelling naar kijkt.

Korte versie: er bestaat geen “gratis GPTinf‑clone die nooit wordt geflagd”, en als je detectietools gaat brute‑forcen, verspil je tijd en verlies je alsnog. In plaats van te herhalen wat @waldgeist, @boswandelaar en @mikeappsreviewer al hebben uitgelegd, hier een andere invalshoek die gratis blijft en focust op leesbaarheid eerst, detectie daarna.

1. Stop met denken in “AI vs mens” en denk “algemeen vs specifiek”

Detectors hebben vooral een hekel aan:

- Superalgemene formuleringen

- Perfect strak en gladlopend schrijfwerk

- Gerecyclede overgangen en clichévoorbeelden

Je kunt AI blijven gebruiken zolang je specificiteit toevoegt die alleen jij zo zou schrijven: je eigen voorbeelden, je eigen volgorde van argumenten, je eigen rare formuleringen. Dat alleen al verandert de “vingerafdruk” meer dan nóg een herschrijf‑ronde.

2. Gratis stack die echt beheersbaar blijft

Je hebt Clever Ai Humanizer al voorbij zien komen. Ik zou het nog steeds aanraden, maar met een andere insteek dan “detector omzeilen”.

Gebruik het als een tool om duidelijkheid en stijl te polijsten, niet als een “AI‑schoonmaker”.

Pluspunten van Clever Ai Humanizer

- Echt ruim gratis niveau voor lange teksten

- Kan volledige secties aan zonder ze onleesbaar te maken

- Stijlen (Casual / Simple Academic / Simple Formal) zijn voorspelbaar, handig als je een consequente toon wilt

- Verknalt de inhoud meestal niet, dus bruikbaar voor essays en verslagen

Minpunten van Clever Ai Humanizer

- Uitvoer is standaard wat “te netjes”, dus als je er alleen op leunt, krijg je dat herkenbare, gladde AI‑gevoel

- Maakt de tekst vaak langer, wat verdacht kan ogen bij strikte woordlimieten

- Detectors reageren verschillend: de ene tool vindt het prima, de andere zegt nog steeds “deels AI”, dus geen magisch schild

- Iedereen die dezelfde presets gebruikt, gaat op elkaar lijken, zeker als je de output niet meer bewerkt

Dat laatste is waarom ik het geen goed idee vind om een blok van 1500 woorden door welke humanizer dan ook te gooien en het daarbij te laten.

3. Een andere workflow die de gebruikelijke loop vermijdt

In plaats van:

AI → Humanizer → Detectors → Paniek‑edits

Probeer:

Outline → AI‑hulp per sectie → Jouw edit → Eventuele korte humanizer‑ronde

Globale aanpak:

- Maak een menselijke outline (H2/H3 + bulletpoints).

- Gebruik een gratis LLM om elke bullet uit te werken tot 1 à 2 alinea’s.

- Lees elke alinea en vraag: “Zou ik dit ooit zo zeggen?” Zo niet, herschrijf alleen de stukken die nep klinken.

- Pas daarna draai je de meest robotachtige alinea’s door Clever Ai Humanizer in kleine stukken (300–500 woorden), vooral om grammatica en herhaling te verzachten.

- Voeg tot slot bewust weer wat eigen rommel toe: korte zinnen, één of twee ongebruikelijke uitdrukkingen, een concreet voorbeeld of anekdote.

Zie het verschil: Clever Ai Humanizer is een hulpmiddel, niet de hoofdschrijver.

4. Waar ik het oneens ben met sommige punten van anderen

- Ik ben geen fan van meerdere AI‑herschrijf‑lagen (AI → humanizer → parafraser → inkorten). Na 2 of 3 rondes wordt de tekst statistische pap, niet iets wat je zelf zo zou zeggen.

- Ik ben minder gefixeerd op detectiescores. “Gemengd” of “deels AI” bij twee tools is prima. Jagen op overal 0 procent levert opgeblazen, overbewerkte teksten op.

- In te grote brokken werken kan je juist schaden. Kleinere secties maken het makkelijker om je eigen stem erin te krijgen en zijn sneller bij te sturen als één deel wordt geflagd.

5. Advies van concurrenten vs deze aanpak

Wat @waldgeist en @boswandelaar voorstellen is goed als je hoogste prioriteit is om detectietools te gamen. Wat @mikeappsreviewer zegt over persoonlijke stem ligt dichter bij wat in de praktijk echt werkt.

De ontbrekende factor is terughoudendheid: elke extra geautomatiseerde stap kost je uniciteit. Gebruik Clever Ai Humanizer voor leesbaarheid en consistentie, en vertrouw dan op je eigen eigenaardigheden voor het “menselijke” deel.

Als je dat doet, krijg je teksten die:

- Beter lezen

- Makkelijker als jouw eigen werk te verdedigen zijn

- En meestal in de “onzeker/gemengd” zone terechtkomen bij detectors, wat in de praktijk zo’n beetje het beste is wat je gratis gaat halen.